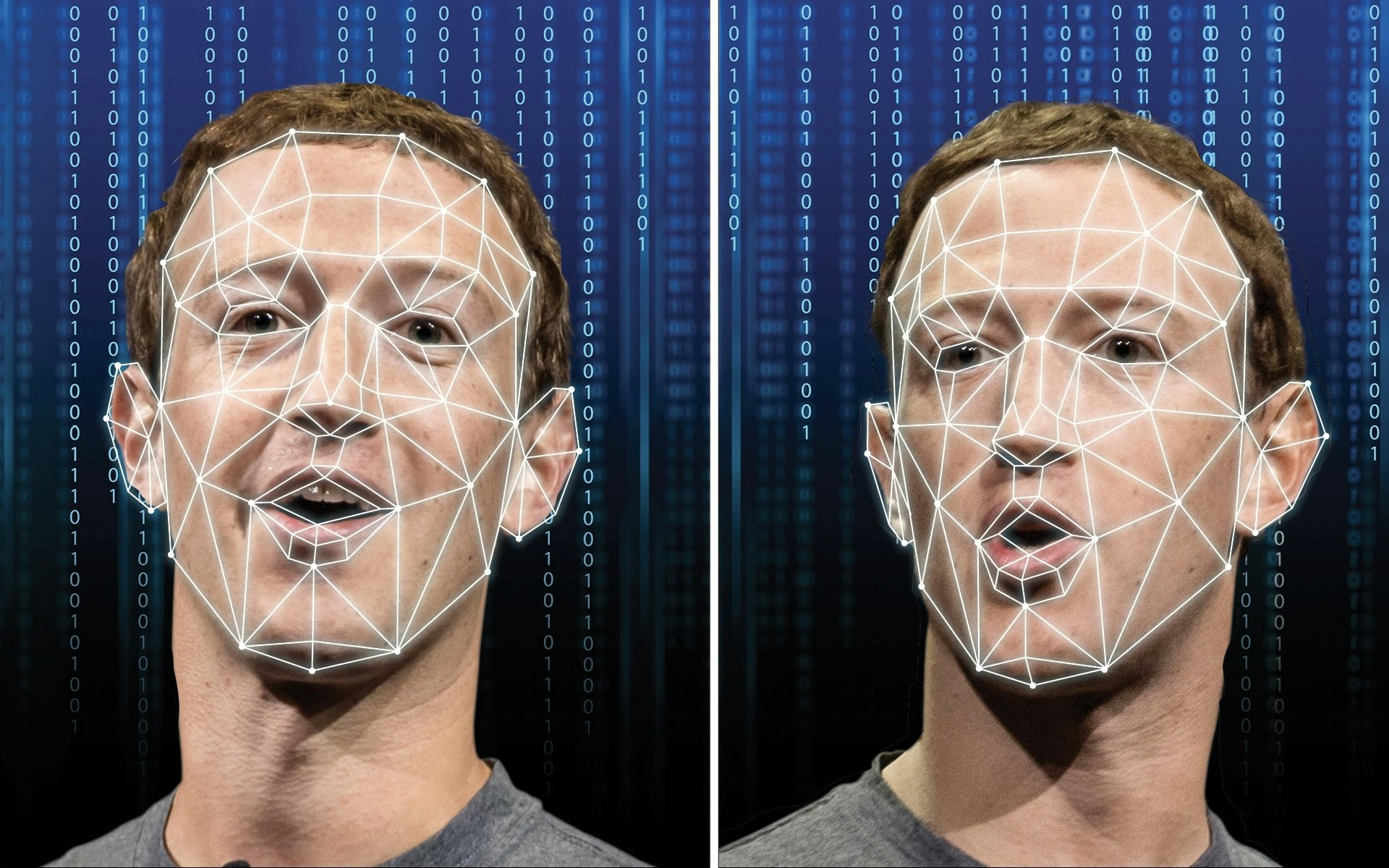

Εταιρείες που χρησιμοποιούν φωτογραφίες ή ηχητικό υλικό για την επαλήθευση της ταυτότητας των πελατών τους προετοιμάζονται για τον κίνδυνο από απάτες που δημιουργήθηκαν μέσω γεννήτριας Τεχνητής Νοημοσύνης. Τα Deepfakes, δηλαδή παραπλανητικά αληθοφανή, τεχνητά παραγόμενες εικόνες ή βίντεο, αποτελούν ήδη θέμα εδώ και κάποιο καιρό στα κοινωνικά μέσα, στις εκλογές και στον δημόσιο τομέα.

Ωστόσο, με την πρόοδο της τεχνολογίας που χρησιμοποιεί τεχνητή νοημοσύνη για να μιμηθεί φωνές και εικόνες πιο ρεαλιστικά από ποτέ, οι απατεώνες με Deepfakes στοχεύουν τώρα και σε επιχειρήσεις. "Πάντα υπήρχαν απατηλές κλήσεις. Αλλά η ικανότητα αυτών των [KI-] μοντέλων να μιμηθούν τα πραγματικά πρότυπα φωνής μιας προσώπου έτσι ώστε να μπορούν να δώσουν οδηγίες σε κάποιον στο τηλέφωνο να κάνει κάτι - αυτές οι είδους κινδύνων είναι εντελώς καινούργιοι", λέει ο Bill Cassidy, Chief Information Officer στην New York Life.

Οι τράπεζες και οι πάροχοι χρηματοοικονομικών υπηρεσιών ανήκουν στους πρώτους στόχους των απατεώνων. Ο Kyle Kappel, επικεφαλής του τομέα Cyber της KPMG στις ΗΠΑ, τονίζει ότι αυτός ο τομέας αναπτύσσεται πολύ γρήγορα. Ένα παράδειγμα της γρήγορης ανάπτυξης είναι η πρόσφατη παρουσίαση μιας τεχνολογίας από το OpenAI, η οποία μπορεί να αναπαράγει μια ανθρώπινη φωνή από ένα κλιπ διάρκειας 15 δευτερολέπτων. Το OpenAI δήλωσε ότι δεν θα καταστήσει την τεχνολογία δημόσια προσβάσιμη μέχρι να γνωρίζει περισσότερα για τους πιθανούς κινδύνους κακοποίησης.

Η ανησυχία είναι ότι οι απατεώνες θα μπορούσαν να χρησιμοποιήσουν αρχεία ήχου που παράγονται από τεχνητή νοημοσύνη για να ξεγελάσουν το λογισμικό ελέγχου φωνητικής αυθεντικότητας το οποίο χρησιμοποιούν οι πάροχοι χρηματοοικονομικών υπηρεσιών για την επαλήθευση των πελατών, για να αποκτήσουν πρόσβαση στους λογαριασμούς τους. Η Chase Bank πρόσφατα ξεγελάστηκε από μια φωνή που παρήχθη από τεχνητή νοημοσύνη. Ωστόσο, η τράπεζα δήλωσε ότι οι πελάτες πρέπει να παρέχουν επιπλέον πληροφορίες για συναλλαγές και άλλα χρηματοοικονομικά αιτήματα.

Αύξηση 700% στα περιστατικά Deepfake στον κλάδο των FinTech το 2023 σε σύγκριση με το προηγούμενο έτος, σύμφωνα με νέα έκθεση της πλατφόρμας επαλήθευσης ταυτότητας Sumsub. Οι εταιρείες εργάζονται για την εφαρμογή επιπλέον μέτρων ασφαλείας για να προετοιμαστούν για το κύμα επιθέσεων που προκαλούνται από τη γενετική Τεχνητή Νοημοσύνη.

Η Cassidy συνεργάζεται για παράδειγμα με την ομάδα Venture Capital της New York Life για να εντοπίσει startups και νέες τεχνολογίες που σχεδιάζονται να αντιμετωπίζουν τα Deepfakes. Ο Alex Carriles, Chief Digital Officer της Simmons Bank, τροποποιεί κάποια πρωτόκολλα επαλήθευσης ταυτότητας. Παλιότερα αυτό σήμαινε ότι οι πελάτες ανέβαζαν φωτογραφίες των διπλωμάτων οδήγησής τους. Πλέον όμως, καθώς οι εικόνες των διπλωμάτων μπορούν εύκολα να παραχθούν με τη χρήση ΑΙ, η τράπεζα συνεργάζεται με τον πάροχο ασφαλείας IDScan.net για να βελτιώσει τη διαδικασία. Αντί να ανεβάζουν ένα υπάρχον εικόνα, οι πελάτες πρέπει τώρα να φωτογραφίσουν τα διπλώματά τους μέσω της εφαρμογής της τράπεζας και να βγάλουν selfies.

Όχι όλες οι τράπεζες βλέπουν άμεσο κίνδυνο. Η Amy Brady, CIO της KeyBank, λέει ότι η τράπεζά της έχει μείνει πίσω τεχνολογικά στην εισαγωγή λογισμικού πιστοποίησης φωνής. Αντιμέτωπη με τον κίνδυνο από τις Deepfakes, το θεωρεί αυτό εκ των υστέρων ως ευτύχημα. Η Brady δηλώνει ότι παγώνει την εισαγωγή του λογισμικού πιστοποίησης φωνής μέχρι να υπάρχουν καλύτερα εργαλεία για την αποκάλυψη των μιμήσεων. „Κάποιες φορές αποδίδει να είσαι ο τελευταίος“, είπε.